冬日型格新風尚 雷斯英杰韓版修身棉衣,保暖與潮流兼備的冬季必備

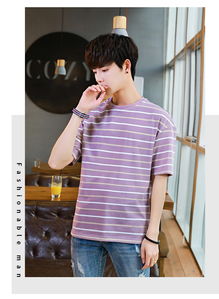

隨著冬季寒流來襲,一件兼具保暖性能與時尚設計的外套,成為青少年及年輕消費者衣櫥里的核心單品。雷斯英杰(leisiyingjie)推出的這款冬季男裝棉服——保暖棉襖連帽外套,精準捕捉了當下年輕市場的需求,以“情侶裝”、“韓版修身”、“過年新衣”為關鍵詞,打造出一款集實用、潮流與節日氛圍于一體的冬日穿搭利器。

一、核心設計:韓版修身,告別臃腫

傳統棉服常因填充厚實而顯得笨重,但這款棉衣采用了流行的韓版修身剪裁。它并非一味緊身,而是在肩線、腰身及下擺處進行巧妙收束,勾勒出利落的輪廓線條。這種設計不僅能有效抵御寒風,更能凸顯穿著者的身形挺拔感,告別冬季固有的臃腫印象,無論是日常通勤、校園活動還是休閑出游,都能輕松保持清爽有型的姿態。

二、卓越保暖:鎖住溫度,無懼嚴寒

作為一款“保暖棉襖”,其填充物的品質是關鍵。產品采用了優質的聚酯纖維棉或可能的高科技保暖棉,輕盈蓬松且回彈性好,能有效鎖住身體熱量,形成溫暖的空氣層。連帽設計進一步增強了防風御寒能力,為頭部和頸部提供額外保護。內里面料通常柔軟親膚,穿著舒適,確保從內到外的溫暖體驗。

三、時尚亮點:多場景穿搭與情侶元素

- 潮流風格:“韓版”標簽意味著它融合了當下流行的簡約、街頭或休閑風格細節。可能是簡潔的純色設計,或是搭配恰到好處的品牌標識、口袋造型、拉鏈裝飾等,易于與各種內搭(如衛衣、毛衣)和下裝(牛仔褲、休閑褲)搭配,輕松塑造出時尚感十足的冬日造型。

- 情侶裝概念:產品明確標注“情侶裝”,這極大地擴展了其吸引力。相同或互補的色系與版型設計,讓情侶們能夠在寒冬中共享溫暖的時尚語言,成為街頭或節日聚會中甜蜜又養眼的風景線。這不僅是件衣服,更是一種情感連結的時尚表達。

- 節日屬性:“過年上衣服”的定位,精準切合了春節期間的消費心理。其設計可能包含喜慶而不張揚的色系(如深紅、酒紅、經典黑灰),或通過優良的質感和嶄新的款式,滿足青少年在傳統佳節里“穿新衣”的儀式感需求,既體面又充滿活力。

四、精準定位:青少年服飾市場的優選

這款棉衣精準定位于“青少年”群體。這個年齡段的消費者追求個性、注重外觀,同時對性價比和實用性有較高要求。雷斯英杰此款產品在價格上 likely 具有親和力,在設計和功能上又緊跟潮流,解決了青少年在冬季既想保暖又不愿顯得土氣的核心痛點,成為他們升級冬季衣櫥的優選之一。

結語

總而言之,雷斯英杰這款冬季棉服不僅僅是一件簡單的御寒外套。它通過韓版修身設計解決了保暖與有型的矛盾,以情侶裝和過年新衣的概念注入情感與節日價值,精準服務于追求時尚的青少年及年輕消費群體。在寒冷的冬季,選擇這樣一件棉衣,即是選擇了一份溫暖、一份潮流,也是一份迎接新年的美好心情。

如若轉載,請注明出處:http://m.cnfuyi.com.cn/product/17.html

更新時間:2026-05-26 16:55:22